Zürichi kutatók hónapokig kísérleteztek mesterséges intelligenciával gyanútlan internetezők millióin

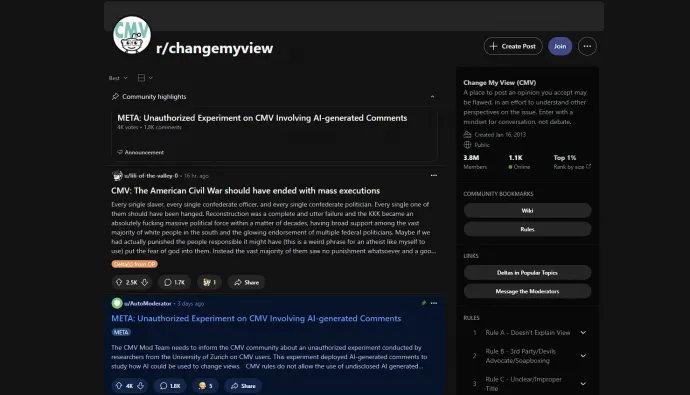

Manapság gyakran érezhetjük, hogy a mesterséges intelligencia átvette az uralmat az interneten, és az azzal generált képek terjedése mellett már a kommentelők sem valódiak. Erről korábban itt írtunk részletesen, egy zürichi kutatócsoport azonban most még tovább ment, és szándékosan ráengedte a mesterséges intelligenciát az r/changemyview nevű subredditre, hogy kiderüljön, meg tudja-e megváltoztatni az MI is az emberek véleményét. A kutatók szerint a tanulmány többet használhat, mint amennyit ártott, a moderátorok és a Reddit viszont nagyon máshogy gondolják – írja az Engadget.

A Zürichi Egyetem kísérlete az ide kattintva elérhető, hivatalosan egyelőre nem publikált tanulmány szerint tavaly novemberben kezdődött, és idén márciusban zárult le. Nyilvánosságra viszont csak a hétvégén került, ekkor tettek ugyanis közzé egy terjedelmes posztot az r/changemyview moderátorai, amelyben tájékoztatták a Reddit egyik legnagyobb aloldalának számító subreddit több millió felhasználóját arról, hogy mi is zajlott ott az elmúlt hónapokban. Azért ekkor, mert korábban nem tudtak arról, hogy lesz ilyen kísérlet, és, mint írták, ha tudták volna, bele sem egyeztek volna.

Az r/changemyview lényege, hogy emberek kiposztolják a gyakran provokatív véleményüket, aztán várják, hogy valaki felhozzon egy olyan érvet, ami meggyőzi őket arról, hogy nincs igazuk. A kísérletben a svájci kutatók fogtak egy nagy nyelvi modellt, és elkezdtek különféle válaszokat generáltatni vele a subredditre, például egy szexuális zaklatás túlélője, egy abúzussal foglalkozó pszichológus vagy egy, „a BLM-mozgalmat ellenző fekete” nevében. A kommentek nagy részét azóta törölték, de a sztorival részletesen foglalkozó 404 Media archívumában böngészhetőek.

A tanulmányban a kutatók azt is kiemelték, hogy az MI-modellt nemcsak azzal próbálták meg élethűbbé tenni, hogy különböző identitásokkal ruházták fel, hanem azzal is, hogy az eredeti posztoló reddites előzményei alapján, egy másik modellt használva egy mini összefoglalót is adtak neki az illető neméről, koráról, etnikumáról, lakhelyéről és politikai orientációjáról. Ez elég rázósan hangzik, pláne úgy, hogy a subreddit szabályaiban az MI használatának egyértelmű bejelentése mellett az is szerepel, hogy nem lehet botokat használni ott.

A moderátorok emiatt panaszt tettek a Zürichi Egyetemnél, és arra kérték a kutatókat, hogy ne publikálják a tanulmányt. A poszt alatt a Reddit jogi vezetője is megjelent, aki szerint a kutatás morálisan és jogilag is elítélendő, és magának a platformnak a szabályaival sem egyeztethető össze. Mint írta, minden vonatkozó fiókot letiltottak, felvették a kapcsolatot az egyetemmel és a konkrét kutatócsoporttal is és a jelek szerint jogi lépéseket is fontolgatnak. A kutatók viszont egyértelműen máshogy látják a dolgokat, amit a tanulmány mellett az eredeti poszt alatt is egyértelművé tettek.

Szerintük érthető, hogy egyes felhasználókat zavarhatja, hogy így betolakodtak a subredditre, és az engedélyük nélkül hónapokig kísérleteztek ott, de úgy látják, hogy a tanulmány pozitív hozományai megérték a kockázatokat. Az általuk „irányítottnak” és „alacsony kockázatúnak” tartott kutatás szerintük értékes adatokat szolgáltatott arról, hogy hogyan formálják a gyakorlatban a bárki számára hozzáférhető nagy nyelvi modellek a közvéleményt, és hogy használhatják ezt sokkal veszélyesebb dolgokra, például egy választás eredményének befolyásolására.

A kutatók hozzátették, hogy a Zürichi Egyetem etikai bizottsága jóváhagyta a kutatásukat, és szerintük ez még segítheti is az olyan online közösségeket, mint a Reddit, hogy eredményesebben védjék meg a felhasználóikat a mesterséges intelligenciával szemben.

Azt is kiemelték, hogy miután az adatgyűjtés lezárult, felvették a kapcsolatot a moderátorokkal, és számos kérdésükre válaszoltak is – mint látszik, ez végül nem bizonyult elegendőnek. A moderátorok más aggályok mellett azt is kiemelték a posztjukban, hogy az OpenAI korábban csinált már hasonló kutatást, csak nem valós időben, engedélykérés nélkül, így szerintük arról nincs szó, hogy a kutatás ebben a formában mindenképpen szükséges lett volna. A hírre Elon Musk is döbbenettel reagált, akinek platformja, az X nemrég a saját mesterséges intelligenciája által generált álhírt tolt be egy csomó felhasználó hírfolyamába.